Nee, ChatGPT heeft geen grote wiskundige puzzel opgelost: Erdős-probleem blijft bestaan

Nieuwswoensdag, 29 april 2026 om 7:00

Een virale claim dat ChatGPT een decennia-oud Erdős-probleem heeft “opgelost”, verspreidt zich snel. De werkelijkheid is nuchterder. Er is geen bevestigde doorbraak in de wiskunde, maar deze episode markeert wel een betekenisvolle verschuiving in hoe AI-gegenereerd redeneren wordt gezien en gebruikt.

Wat er echt gebeurde

De claim komt voort uit een gedeeld ChatGPT-gesprek waarin het model een wiskundig betoog geeft over een open probleem op erdosproblems.com. De output oogt gestructureerd, gebruikt geavanceerde notatie en lijkt bekende resultaten uit te bouwen.

Dat heeft sommige lezers doen concluderen dat het probleem is opgelost.

Daar is geen bewijs voor.

Problemen van dit type vereisen:

- een formele uitwerking in een paper

- verificatie door meerdere experts

- aanhoudende toetsing binnen de wiskundige gemeenschap

Aan geen van die voorwaarden is voldaan. Zonder dat geldt er geen enkele aanspraak op een “oplossing”.

Waar de claim stukloopt

Een nadere blik op het gegenereerde betoog laat zien waarom de conclusie voorbarig is.

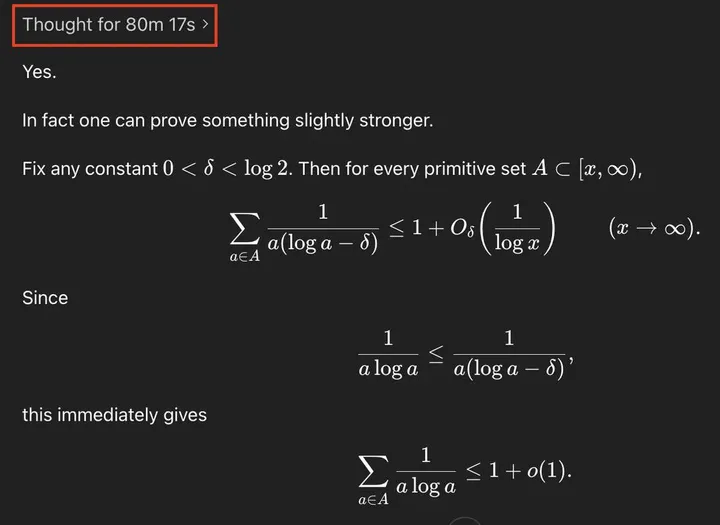

Het model presenteert zijn resultaat als:

- “men kan iets sterkers bewijzen”

- gevolgd door een asymptotische ongelijkheid met big-O-notatie

Dit is kenmerkend voor heuristische of gedeeltelijke redeneringen, niet voor definitieve bewijzen.

Specifiek geldt:

- asymptotische grenzen lossen niet automatisch de volledige structuur van een combinatorisch probleem op

- de redenering leunt op ongelijkheden die mogelijk niet uniform gelden in alle vereiste gevallen

- kritieke stappen worden gesteld zonder volledige verantwoording

In de geavanceerde wiskunde zijn dit geen details. Eén niet-onderbouwde stap maakt het hele resultaat ongeldig.

In het beste geval heeft het model opgeleverd:

- een plausibele schets

- een recombinatie van bekende technieken

- mogelijk een herformulering van bestaande deelresultaten

Dat is categorisch iets anders dan het oplossen van een open probleem.

Waarom de output overtuigend oogt

De reactie is begrijpelijk.

Moderne taalmodellen kunnen:

- de structuur van formele bewijzen reproduceren

- bekende technieken in nieuwe combinaties toepassen

- lange ketens van symbolisch redeneren volhouden

Voor niet-specialisten is dat niet te onderscheiden van echte wiskundige vooruitgang.

Maar wiskundige geldigheid draait niet om stijl. Ze draait om strengheid onder toetsing. In die kloof tussen uiterlijk en verificatie ontstaat de verwarring.

Wat dit zegt over AI-vermogen

Het belangrijkste signaal is niet de onjuiste claim, maar het type output dat haar uitlokte.

Het model toont:

- coherente redenering over meerdere stappen

- vertrouwdheid met geavanceerde wiskundige hulpmiddelen

- het vermogen om patronen uit te breiden voorbij directe memorisatie

Dat gaat in de praktijk verder dan eenvoudig tekstvoorspellen. Het laat zien dat AI-systemen nu kandidaat-redeneerpaden in technische domeinen kunnen genereren.

Maar genereren is geen begrijpen, en het is geen bewijs.

De echte flessenhals: verificatie

Deze episode markeert een structurele verschuiving.

AI-systemen worden goed in:

- het produceren van plausibele bewijzen

- het aandragen van strategieën

- het snel verkennen van de oplossingsruimte

Maar verificatie blijft:

- traag

- afhankelijk van experts

- onverbiddelijk

In de wiskunde en andere domeinen met hoge inzet is de beperkende factor niet langer idee-generatie, maar validatie.

Waarom dit ertoe doet

Voor bestuurders, onderzoekers en beleidsmakers is de implicatie praktisch. AI-hulpmiddelen zullen steeds vaker output produceren die:

- er correct uitziet

- gezaghebbend klinkt

- domeinexpertise vereist om te valideren

Dat creëert nieuwe risico’s:

- te veel vertrouwen in vloeiende output

- fouten versneld in besluitvorming brengen

- vermogen overschatten op basis van presentatiekwaliteit

En nieuwe kansen:

- snellere hypothesevorming

- verrijkte onderzoeksworkflows

- vroegere detectie van veelbelovende richtingen

De beperking verschuift van toegang tot ideeën naar het vermogen ze te filteren.

Wat nu in de gaten te houden

Er zijn drie concrete ontwikkelingen om te volgen:

- Of wiskundigen het specifieke, door ChatGPT gegenereerde betoog formeel analyseren

- De opkomst van tools die helpen bij bewijsverificatie, niet alleen generatie

- Hybride werkprocessen waarin AI voorstelt en experts op schaal valideren

Als het betoog iets echt nieuws bevat, zal dat via dit proces boven komen drijven. Zo niet, dan zal het geruisloos instorten onder toetsing, zoals vele plausibele bewijzen doen.

De kern

ChatGPT heeft geen 60 jaar oud Erdős-probleem opgelost.

Maar het produceerde wel iets dat genoeg op een bewijs leek om duizenden mensen te overtuigen dat het mogelijk was.

Die kloof tussen overtuigende output en geverifieerde waarheid is nu een van de belangrijkste realiteiten in toegepaste AI.

Populair nieuws

Laatste reacties

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

- Sterk stuk! Dit onderstreept waarom “AI bias” en “betrouwbaarheid van AI” cruciaal zijn voor onderwijs en bedrijfslevenkevinkunstmatigh30-10-2025

- Als D66 de verkenner en mogelijk premier levert, dan wordt de toon technocratisch en pragmatischoptimaliserenotto3230-10-2025

Loading