Onderzoekers van onder meer de University of California, Los Angeles en Amazon publiceren eind april 2026 een studie waarin zij aantonen dat moderne AI-systemen structureel tekortschieten in het toepassen van nieuw ontdekte kennis.

Hun benchmark, gebaseerd op Minecraft, laat zien dat zelfs de meest geavanceerde modellen gemiddeld slechts 26 procent van de taken succesvol afronden.

De implicatie is direct relevant voor Nederland: AI-systemen die ogenschijnlijk goed redeneren, blijken moeite te hebben met de stap van inzicht naar praktische uitvoering. Dit raakt sectoren als industrie, onderwijs en beleid, waar juist die vertaalslag cruciaal is.

Wat onderzoekt deze studie precies?

De kernvraag is eenvoudig: kan AI zelf iets ontdekken én dat vervolgens toepassen? De onderzoekers noemen dit de “discovery-to-application loop”. Dit is het proces waarbij:

- een systeem een kennisgat herkent

- experimenten uitvoert

- inzichten vastlegt

- en die inzichten toepast in een werkende oplossing

Dit proces vormt de basis van menselijke innovatie, van wetenschap tot engineering. Volgens de studie ontbreekt juist deze samenhang nog grotendeels bij AI.

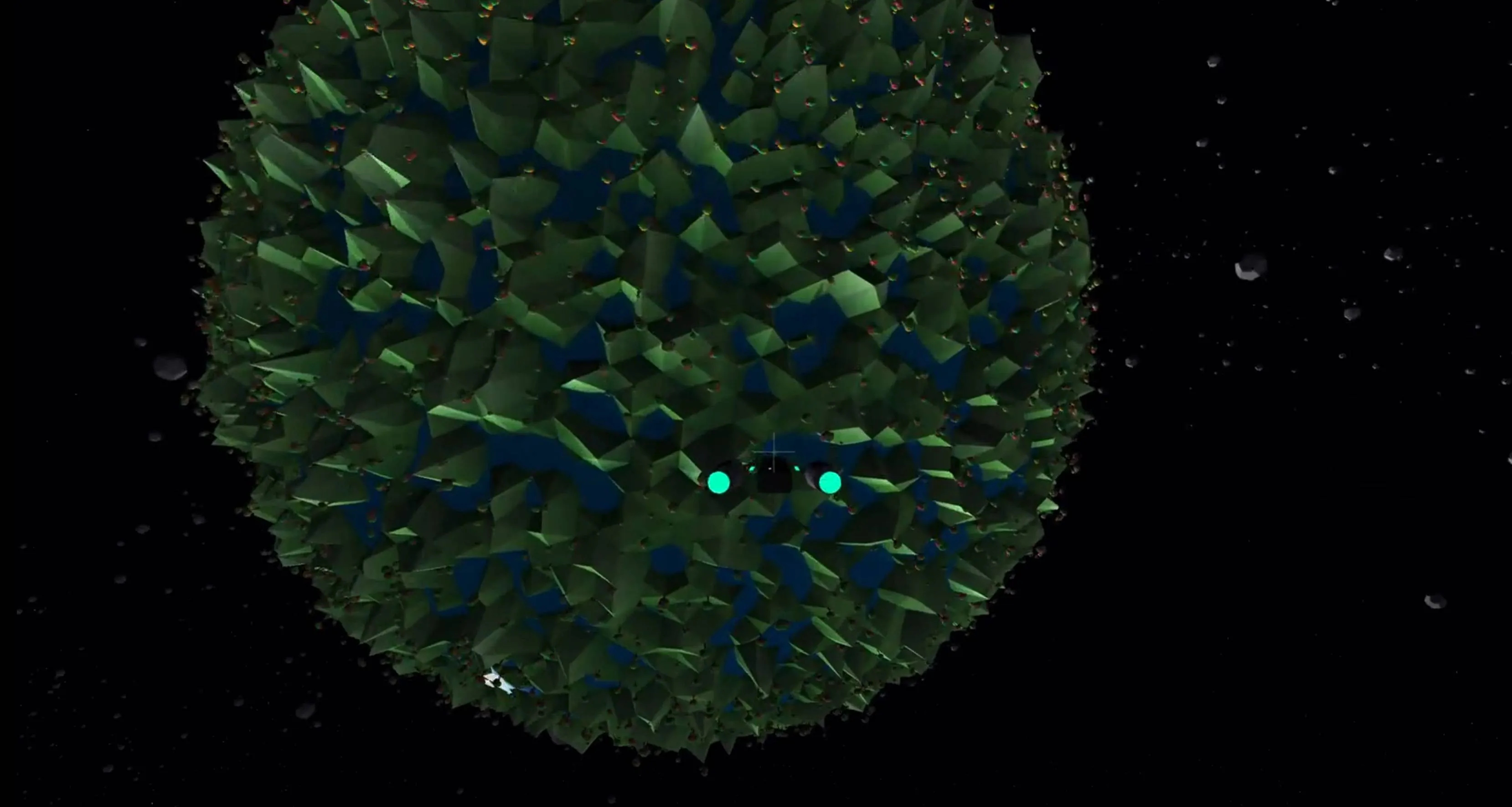

Waarom Minecraft als testomgeving?

De onderzoekers gebruiken Minecraft als experimentele omgeving omdat het een gecontroleerde maar complexe wereld biedt. In het spel kunnen agents elektrische circuits bouwen met zogenoemde “redstone”-mechanieken.

Deze omgeving heeft drie voordelen:

- Controleerbare complexiteit: taken worden moeilijker door parameters aan te passen

- Realistische causaliteit: systemen reageren volgens vaste regels

- Geen voorkennis mogelijk: agents moeten echt ontdekken hoe het werkt

Een voorbeeldtaak: laat 64 lampen tegelijk aangaan binnen een beperkte ruimte. Dit vereist inzicht in signaalverlies, timing en circuitontwerp.

Hoe presteren huidige AI-modellen?

De onderzoekers testen onder meer:

- GPT-5.2

- Gemini-3-Pro

- Claude-Opus-4.5

De uitkomst is opvallend consistent: alle modellen blijven steken rond de 26 procent succesratio.

Dit betekent dat driekwart van de taken mislukt, ondanks toegang tot tools, geheugen en meerdere pogingen.

Waar gaat het precies mis?

De studie identificeert vier fundamentele capaciteiten waarin AI tekortschiet:

1. Herkennen van kennisgaten

AI weet vaak niet wat het nog niet weet. Wanneer onderzoekers hints geven, verdubbelt de prestatie.

2. Experimenteren

Een aparte “scientist agent” die systematisch experimenten uitvoert, verhoogt succes verder tot circa 64 procent.

3. Kennis structureren

De manier waarop kennis wordt opgeslagen blijkt cruciaal. Gestructureerde formats werken aanzienlijk beter dan vrije samenvattingen.

4. Toepassen van kennis

De grootste bottleneck blijft echter uitvoering: het daadwerkelijk bouwen van een werkend systeem.

De onderzoekers concluderen dat vooral deze laatste stap nog zwaar onderontwikkeld is.

Belangrijk inzicht: AI stelt de verkeerde vragen

Een opvallende bevinding is dat bij de meest geavanceerde modellen het probleem verschuift. Niet het oplossen van problemen is de grootste uitdaging, maar het formuleren van de juiste vragen.

Dit sluit aan bij een klassiek inzicht van Albert Einstein: het correct definiëren van een probleem is vaak belangrijker dan het oplossen ervan.

Voor AI betekent dit dat systemen nog onvoldoende begrijpen waar ze moeten zoeken naar nieuwe kennis.

Wat betekent dit voor Nederland?

Deze bevindingen hebben directe implicaties voor Nederlandse AI-toepassingen:

Industrie en automatisering

Bedrijven die AI inzetten voor ontwerp of engineering kunnen tegen grenzen aanlopen. AI kan suggesties doen, maar faalt bij complexe implementaties.

Onderwijs en onderzoek

AI als “onderzoekspartner” is nog beperkt betrouwbaar. Studenten en onderzoekers moeten kritisch blijven op gegenereerde oplossingen.

Arbeidsmarkt

De rol van menselijke experts blijft cruciaal. Vooral in functies waar inzicht en toepassing samenkomen, zoals engineering en data science.

Beleidsvorming

Voor beleidsmakers betekent dit dat verwachtingen rond autonome AI-systemen moeten worden bijgesteld. Volledige automatisering van complexe besluitvorming is voorlopig niet realistisch.

Waarom dit onderzoek belangrijk is

Deze studie verschuift de discussie over AI-capaciteiten. Tot nu toe lag de focus op taalbegrip en redeneren. Dit onderzoek laat zien dat:

- redeneren ≠ toepassen

- kennis ≠ begrip

- output ≠ functionaliteit

Het benadrukt dat echte intelligentie niet alleen zit in antwoorden geven, maar in het bouwen van werkende oplossingen.

Lees ook

Conclusie: AI mist nog een cruciale schakel

De conclusie is helder: huidige AI-systemen missen een fundamentele schakel tussen denken en doen.

Hoewel modellen steeds beter worden in redeneren en experimenteren, blijft de praktische toepassing achter. Dit maakt AI voorlopig een hulpmiddel, geen autonome probleemoplosser.

Voor Nederland betekent dit dat de inzet van AI strategisch moet blijven: ondersteunend waar mogelijk, maar altijd onder menselijke regie bij complexe toepassingen.

Populair nieuws

AI draait op kobalt: de verborgen toeleveringsketen die AI aandrijft

Meta botst met China na miljardenovername van AI-agentmaker Manus

EuropeMedQA legt zwakke plek medische AI in Europa bloot

Hoe de rechtszaak van Musk tegen Altman de machtsverhoudingen rond AI kan verschuiven

OpenAI verzwakt Microsofts greep op toekomst

Taylor Swift vecht tegen deepfakes en wil stem beschermen tegen AI

Laatste reacties

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

- Sterk stuk! Dit onderstreept waarom “AI bias” en “betrouwbaarheid van AI” cruciaal zijn voor onderwijs en bedrijfslevenkevinkunstmatigh30-10-2025

- Als D66 de verkenner en mogelijk premier levert, dan wordt de toon technocratisch en pragmatischoptimaliserenotto3230-10-2025

Loading