Buzzword ‘clinical-grade AI’ blijkt weinig betekenis te hebben

Nieuwsmaandag, 27 oktober 2025 om 17:00

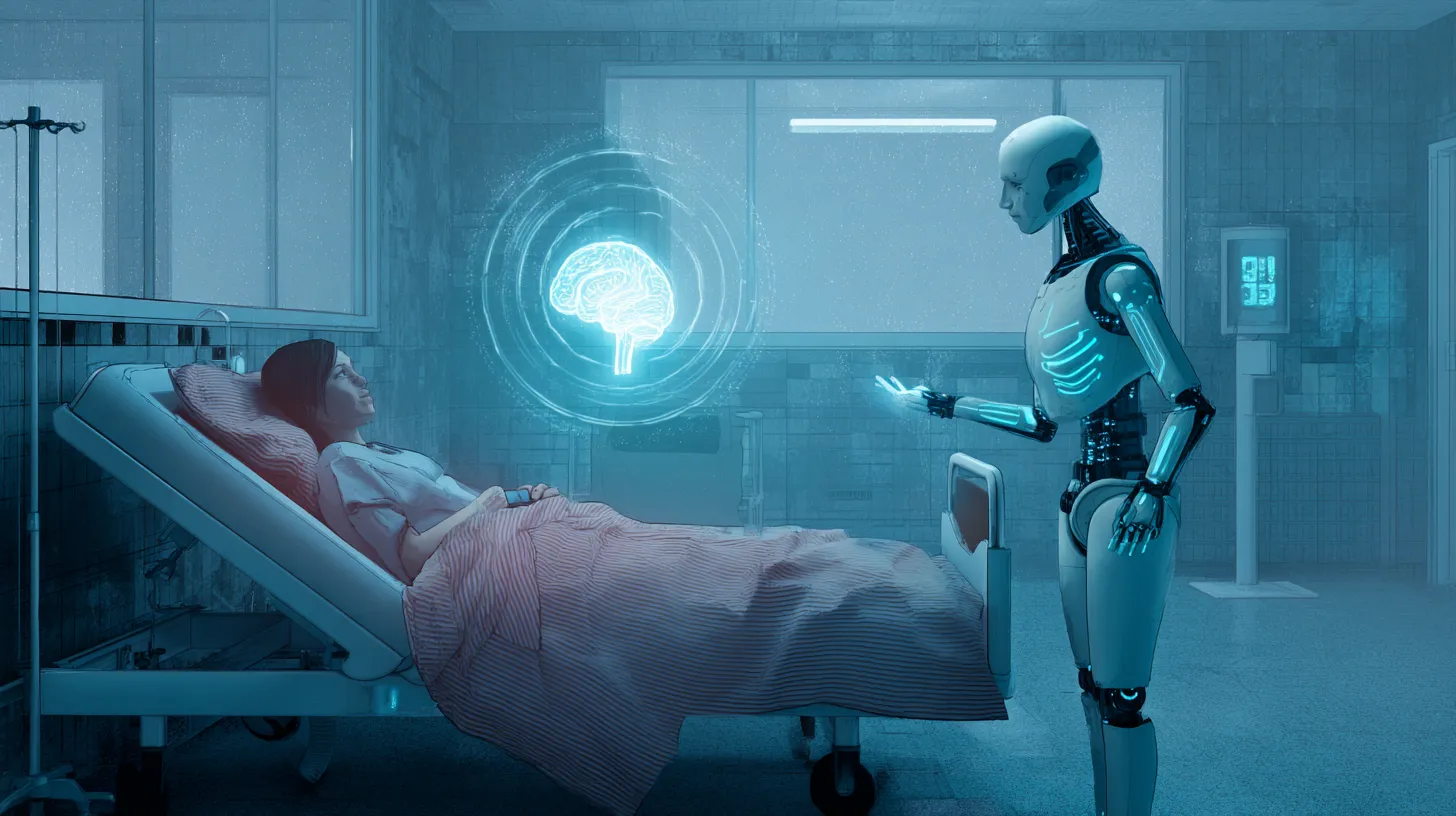

Technologiebedrijven gebruiken steeds vaker de term ”clinical-grade AI”, maar wat het precies inhoudt, blijft vaag. In een recent artikel met de titel “‘Clinical-grade AI’: a new buzzy AI word that means absolutely nothing”wordt uitgelegd dat de term vooral marketingtaal is, zonder duidelijke juridische of regulatoire basis, volgens The Verge.

Het woord in de praktijk

Een voorbeeld: het bedrijf Lyra Health kondigde een chatbot aan voor mentale gezondheid, die omschreven werd als “clinical-grade”, “clinically designed” en “clinically rigorous”. Daarmee zou de tool ondersteuning bieden bij stress, burn-out en slaapproblemen. Hoewel die bewoording sterk klinkt, geeft Lyra zelf toe dat het product niet erkend is als medisch hulpmiddel en dus niet gereguleerd wordt door bijvoorbeeld de Food and Drug Administration (FDA) in de VS. Experts zeggen dat de term “clinical-grade AI” geen gestandaardiseerde betekenis heeft. Zo zegt jurist en arts George Horvath: “Ik heb geen FDA-document gezien dat die term gebruikt, het staat niet in wet of regelgeving.”

Waarom het een probleem is

Het gebruik van een term zoals “clinical-grade” schept verwachtingen: gebruikers kunnen denken dat ze te maken hebben met een regulier medisch product dat getest is op veiligheid, effectiviteit en deskundig toezicht. Maar wanneer een tool geen medische classificatie heeft of geen klinische trials, is die indruk misleidend. Het artikel vergelijkt de term met andere vaagheden in marketing zoals “pharmaceutical-grade” of “doctor-formulated”: het klinkt sterk, maar betekent vaak weinig concreets. Daarnaast kiezen bedrijven er bewust voor om zich buiten de regulering van medische hulpmiddelen te plaatsen. Zo vermijden ze de langdurige procedures en hoge kosten die verband houden met goedkeuring door de FDA, terwijl ze toch termen gebruiken die suggereren dat ze in dat domein horen.

Wat betekent dit voor gebruikers en zorg

Voor consumenten en zorgprofessionals is het van belang te beseffen dat “clinical-grade AI” géén garantie is voor kwaliteit of veiligheid. Zonder expliciete definitie, certificering of toezicht blijft er een grote mate van onzekerheid. In medisch toepassingsgebied zouden tools idealiter worden getest in klinische studies, onder toezicht van regulerende instanties, en duidelijk aangeven wat hun beperkingen zijn. Maar de huidige praktijk laat zien dat veel AI-producten deze route niet nemen. Bovendien waarschuwen experts dat het ontbreken van degelijk bewijs of toezicht risico’s met zich meebrengt: als gebruikers denken dat iets medisch goedgekeurd is, kunnen ze minder kritisch zijn of professionele hulp uitstellen.

De juiste toon zetten

Het debat rond AI in de zorg is complex. Er is onmiskenbaar potentie: AI kan helpen bij diagnose, monitoring of het verwerken van grote hoeveelheden medische data. Academisch onderzoek wijst erop dat betrouwbare kaders en normen hard nodig zijn om AI veilig in de praktijk te brengen. Maar het artikel van The Verge benadrukt dat termen zoals “clinical-grade” eerst betekenis moeten krijgen voordat ze breed ingezet mogen worden als signaal van kwaliteit. Voor nu geldt: de term klinkt indrukwekkend, maar of hij inhoudelijk veel zegt, is twijfelachtig.

Kortom: wanneer u een product tegenkomt met de claim “clinical-grade AI”, is het verstandig om verder te kijken dan de claim zelf. Vraag naar bewijs, regulering, klinische validatie en transparantie. Want in de wereld van gezondheids-AI zijn de woorden vaak vooruit op de praktijk.

Lees ook

doorMaartje

Populair nieuws

Talkie: Een AI-model getraind op data van vóór 1931

Elon Musk beschuldigt 'Scam Altman' van plunderen van OpenAI

Nee, ChatGPT heeft geen grote wiskundige puzzel opgelost: Erdős-probleem blijft bestaan

AI wordt het besturingssysteem van Big Tech: OpenAI, GPU‑schaarste en cloudgroei sturen miljarden aan investeringen

Europa test macht over Big Tech met boete tot 12 miljard voor Meta

Zorgsector omarmt skill-based leren, AI versnelt proces maar zorgt ook voor problemen

Laatste reacties

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

- Sterk stuk! Dit onderstreept waarom “AI bias” en “betrouwbaarheid van AI” cruciaal zijn voor onderwijs en bedrijfslevenkevinkunstmatigh30-10-2025

- Als D66 de verkenner en mogelijk premier levert, dan wordt de toon technocratisch en pragmatischoptimaliserenotto3230-10-2025

Loading