AI browsers zijn handig, maar vormen nog altijd een groot veiligheidsrisico

Nieuwsmaandag, 05 januari 2026 om 10:49

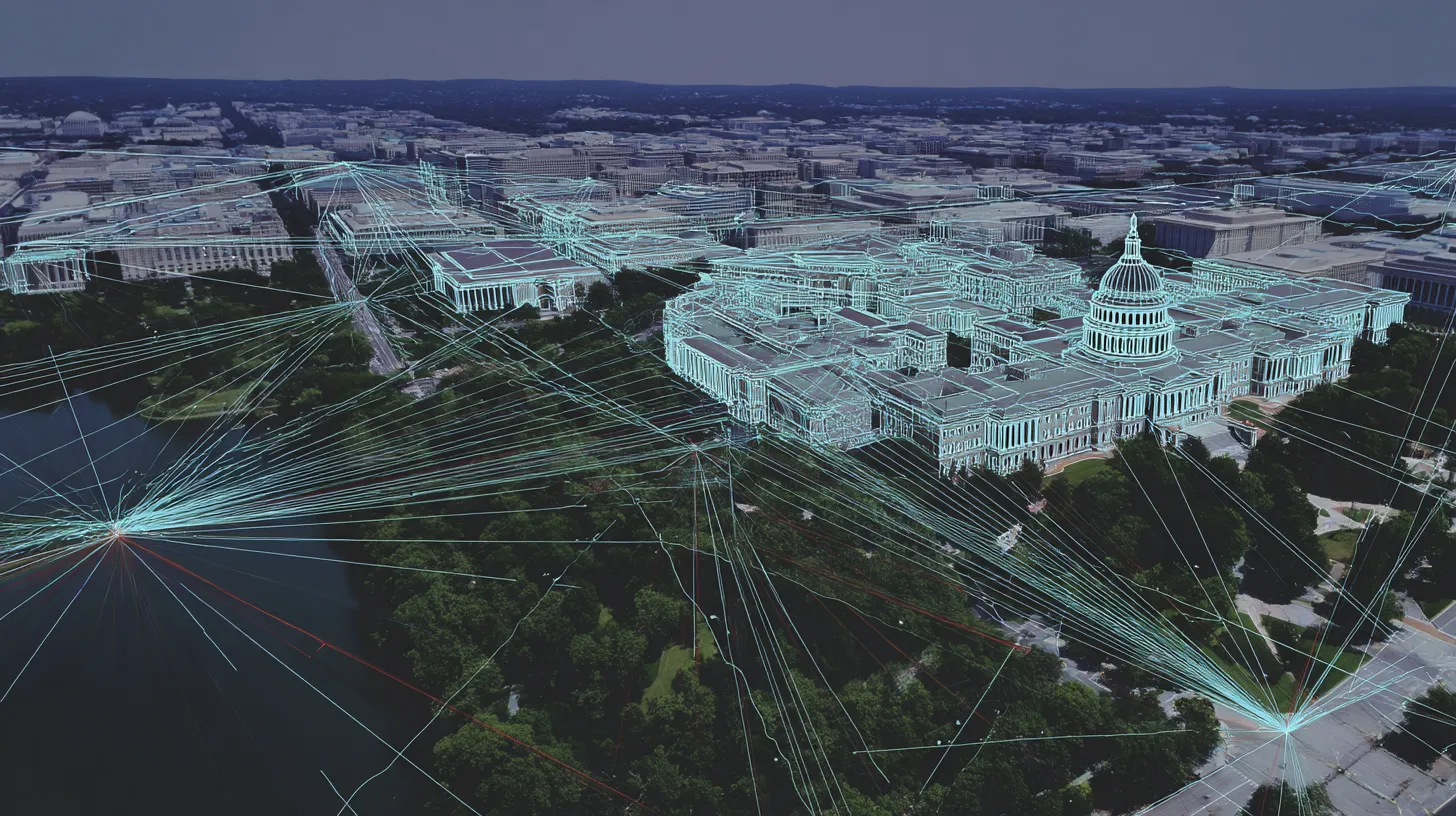

AI-browsers klinken als de volgende logische stap in onze digitale evolutie. Ze lezen webpagina’s, vatten informatie samen en kunnen zelfs acties voor je uitvoeren. Handig, snel en efficiënt. Maar onder die slimme buitenkant schuilt een risico waar zelfs de makers van deze technologie niet omheen kunnen. Het gaat niet om een tijdelijk lek of een simpele bug, maar om een fundamenteel probleem dat met elke nieuwe AI-functie groter wordt. En dat maakt deze ontwikkeling zowel fascinerend als ongemakkelijk.

Prompt injection vormt groot risico

De kern van het probleem heet prompt injection. Dat klinkt technisch, maar het idee is simpel. Kwaadaardige instructies worden verstopt in webpagina’s, documenten of e-mails. Mensen zien ze niet, maar AI-systemen wel. Zodra een AI-browser zo’n verborgen instructie leest, kan hij worden misleid om iets te doen wat eigenlijk niet de bedoeling is.

Volgens OpenAI is dit risico niet volledig op te lossen. En dat is opvallend, want zelden hoor je een techbedrijf zo open toegeven dat een probleem structureel is. De reden is dat AI-browsers steeds autonomer worden. Ze lezen niet alleen informatie, maar kunnen ook klikken, mails versturen of bestanden openen. Een slimme prompt injection kan dan genoeg zijn om schade aan te richten.

Die dreiging wordt groter in zogeheten agent mode. In functies zoals ChatGPT Atlas voert de AI zelfstandig taken uit. Dat vergroot het aanvals vlak. De AI hoeft niet gehackt te worden, hij wordt simpelweg overtuigd.

Waarom dit risico niet zomaar verdwijnt

OpenAI staat niet alleen in deze waarschuwing. Ook partijen als Brave, Perplexity en de Britse National Cyber Security Centre wijzen op prompt injection als een fundamenteel AI-risico. Er is geen knop die je omzet om het probleem te laten verdwijnen.

In plaats daarvan kiezen ontwikkelaars voor een gelaagde aanpak. Continue updates, uitgebreide tests en meerdere beveiligingslagen moeten het risico beperken. OpenAI gebruikt zelfs een AI-aanvaller die automatisch probeert zwakke plekken te vinden. AI tegen AI dus. Dat helpt, maar het neemt het kernprobleem niet weg.

De aantrekkingskracht voor aanvallers is duidelijk. AI-browsers combineren toegang tot gevoelige data met automatisch handelen. Dat is een zeldzame en krachtige combinatie. Voor gebruikers betekent dit dat voorzichtigheid geboden blijft. Beperk de rechten van AI-tools, vraag altijd bevestiging bij gevoelige acties en zorg dat wachtwoorden en software up-to-date zijn.

Lees ook

Populair nieuws

Laatste reacties

- Dit artikel is van 1 april, dus deze belasting is niet echt. Gelukkig maar. :)

RobinHeester12-05-2026

RobinHeester12-05-2026 - Of een ander land..dat lijkt mij beterHan10-05-2026

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

Loading