Kunstmatige intelligentie heeft een nieuwe fase bereikt. Deepfakes zijn niet langer curiositeiten of entertainmentexperimenten, maar functioneren inmiddels als operationeel wapen voor grootschalige fraude.

De directe aanleiding is een recente zaak waarin een belegger zijn volledige Bitcoin-pensioen verliest aan een AI-gestuurde romancescam. Wat opvalt, is niet de crypto zelf, maar de rol van AI. Zonder deepfakes had deze fraude niet kunnen slagen.

Dit verhaal past in een bredere ontwikkeling die AI Wereld al langer volgt. Van CEO-dubbelgangers en stemklonen tot hyperrealistische video’s van publieke figuren. Digitale identiteit is in rap tempo losgeraakt van de echte wereld.

Een relatie die alleen in AI bestond

De zaak draait om een recent gescheiden Bitcoin-investeerder. Hij wordt online benaderd door een vrouw die interesse toont in hem én in crypto. Er volgen gesprekken, videogesprekken en plannen voor een gezamenlijke toekomst. Alles voelt authentiek. De gezichtsuitdrukkingen kloppen. De stem reageert emotioneel. Het contact voelt menselijk.

Maar de vrouw bestaat niet.

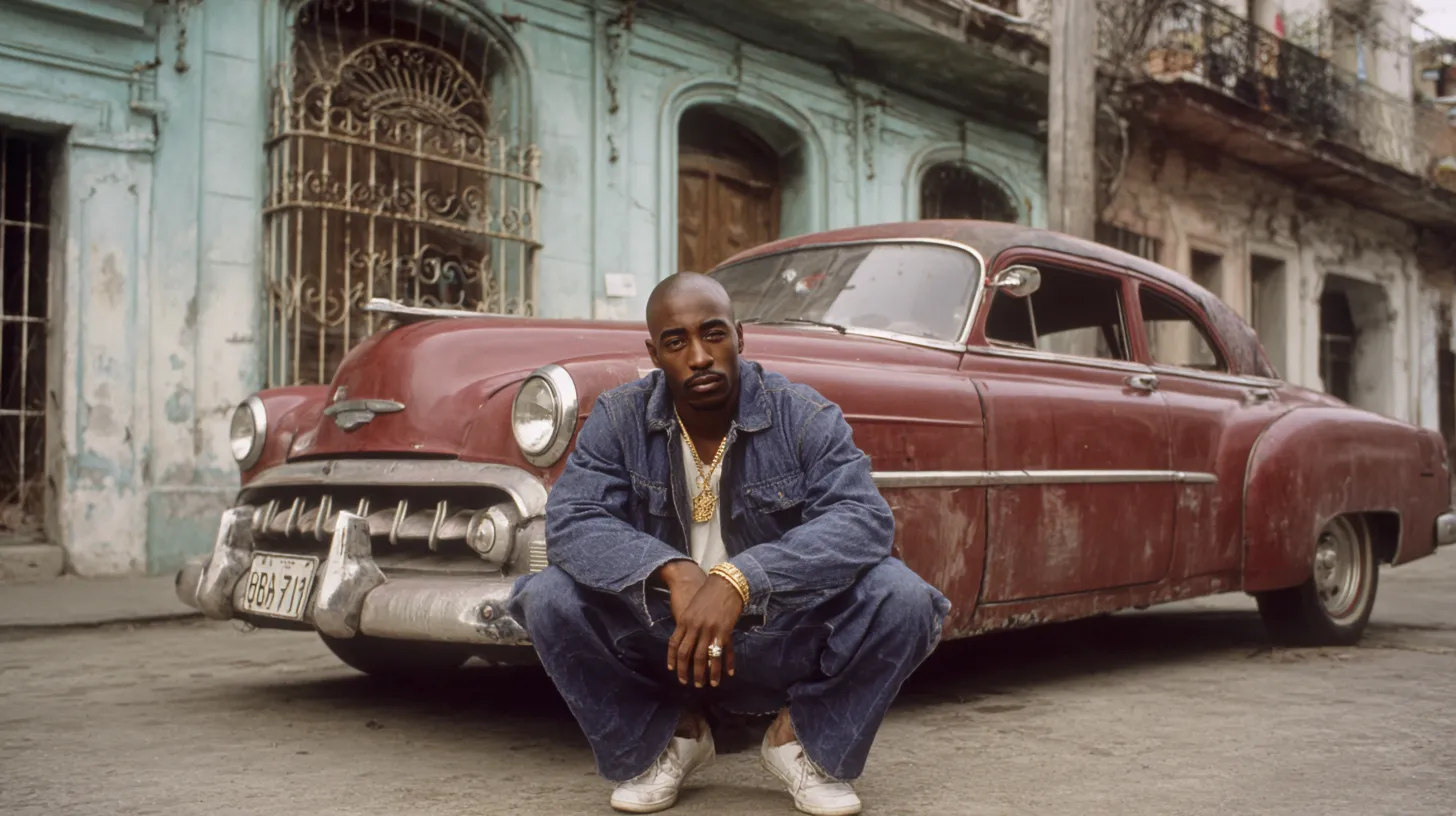

De fraudeur gebruikt realtime deepfakevideo’s en volledig door AI gegenereerde portretten. Het gezicht dat de man ziet, is synthetisch. De persoonlijkheid is geconstrueerd. De relatie is een simulatie. Wanneer het vertrouwen groot genoeg is, vraagt de digitale partner om hulp bij een investering. De man maakt meerdere Bitcoin-transacties over. Zodra de laatste transactie onomkeerbaar op de blockchain staat, verdwijnt de persoon voorgoed.

Waarom deze scam anders is dan eerdere oplichting

Romancescams bestaan al jaren, maar AI verandert de spelregels. Waar oplichters vroeger afhankelijk waren van chatberichten en gestolen foto’s, creëren ze nu volwaardige digitale identiteiten. Dankzij deepfakevideo’s verdwijnt de laatste verdedigingslinie van slachtoffers. Videobellen, ooit hét bewijs van echtheid, is geen garantie meer.

Volgens blockchainonderzoeker Chainalysis veroorzaken dit soort relationele scams inmiddels miljardenverliezen per jaar. De transacties lijken legitiem. Slachtoffers handelen vrijwillig. Detectiesystemen zien geen alarmsignalen.

AI maakt fraude niet alleen geloofwaardiger, maar ook schaalbaar. Eén crimineel kan meerdere slachtoffers tegelijk bespelen, ondersteund door scripts, stemklonen en gezichtsmodellen.

Deepfakes raken de kern van online identiteit

Deze Bitcoin-zaak staat niet op zichzelf. In de afgelopen maanden waarschuwen bedrijven en toezichthouders voor een explosie aan AI-identiteitsfraude.

- CEO-dubbelgangers verschijnen in videogesprekken en dwingen medewerkers tot spoedbetalingen.

- Beleggingsfraude gebruikt deepfakevideo’s van bekende investeerders.

- Stemklonen bootsen leidinggevenden na met perfecte intonatie en timing.

Investeringsmaatschappij Berkshire Hathaway waarschuwt expliciet voor nepvideo’s van Warren Buffett. Tegelijkertijd ligt OpenAI onder vuur vanwege extreem realistische AI-video’s die nauwelijks van echt te onderscheiden zijn.

De conclusie is ongemakkelijk. Beeld, stem en zelfs live interactie zijn geen betrouwbaar bewijs van identiteit meer.

Waarom mensen extra kwetsbaar zijn

AI-fraude richt zich niet willekeurig op slachtoffers. In dit geval speelt een recente scheiding een cruciale rol. Emotionele kwetsbaarheid vergroot de gevoeligheid voor bevestiging, aandacht en toekomstperspectief. AI versterkt dat effect door empathie te simuleren.

De deepfake reageert altijd begripvol. Ze wordt nooit boos. Ze luistert eindeloos. Dit is geen toeval, maar ontwerp. Moderne AI-modellen zijn getraind om menselijke emoties te herkennen en daarop te sturen.

De harde realiteit van digitale onomkeerbaarheid

Zodra crypto wordt overgemaakt, is herstel vrijwel onmogelijk. Er bestaan geen terugboekingen, geen geschillencommissie en geen vangnet. Dat maakt AI-gestuurde fraude extra vernietigend. Slachtoffers verliezen niet alleen geld, maar ook vertrouwen in hun eigen waarneming.

De psychologische schade is groot. Het besef dat een intieme relatie volledig geautomatiseerd was, werkt ontwrichtend. Het is geen klassieke diefstal, maar een aantasting van identiteit en realiteit.

Lees ook

Wat deze zaak ons leert over de toekomst

De Bitcoin-romancescam is geen crypto-verhaal. Het is een AI-verhaal. Het toont hoe snel deepfakes zijn geëvolueerd van gimmick naar infrastructuur voor misbruik. In 2026 wordt identiteitsverificatie één van de grootste maatschappelijke vraagstukken rond kunstmatige intelligentie.

Voor AI Wereld is dit een duidelijk signaal. De discussie over deepfakes gaat niet meer over techniek alleen, maar over vertrouwen, waarheid en menselijk contact. Wie in de toekomst nog denkt dat ‘zien geloven is’, loopt achter.

De vraag is niet of deepfakes onze digitale samenleving veranderen. Dat doen ze al. De vraag is of we op tijd leren omgaan met een wereld waarin gezichten, stemmen en relaties net zo goed door een algoritme kunnen zijn bedacht.

Populair nieuws

Laatste reacties

- Dit artikel is van 1 april, dus deze belasting is niet echt. Gelukkig maar. :)

RobinHeester12-05-2026

RobinHeester12-05-2026 - Of een ander land..dat lijkt mij beterHan10-05-2026

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

Loading