Google past AI aan na ophef: Eet stenen, paarden met zes benen en rennen met een schaar

Nieuwsvrijdag, 31 mei 2024 om 18:59

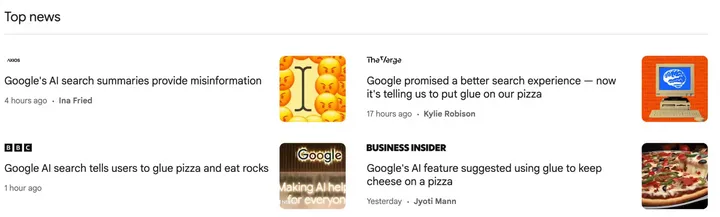

Google heeft onlangs de AI-integraties in zijn zoekresultaten gedeeltelijk teruggedraaid na enkele opmerkelijke fouten in de antwoorden die door de AI Overviews werden gegenereerd. Gebruikers meldden dat de zoekmachine antwoorden gaf zoals dat een paard zes voeten zou kunnen hebben, mensen dagelijks kleine porties steen moeten eten, en dat pizzakaas goed vastgelijmd moet worden.

In de recente aanpassingen aan de AI-infrastructuur van Google, zijn diverse maatregelen getroffen om de betrouwbaarheid en nauwkeurigheid van AI-overzichten te verbeteren. Deze aanpassingen richten zich op het beperken van misleidende en onjuiste informatie, met speciale aandacht voor gevoelige onderwerpen zoals nieuws en gezondheid. De volgende stappen zijn genomen volgens een blogpost van Google:

- Detectiemechanismen voor onzinnige zoekopdrachten:Er zijn verbeterde detectiemechanismen geïmplementeerd om onzinnige zoekopdrachten te identificeren en te voorkomen dat hiervoor een AI-overzicht wordt weergegeven..

- Beperking van satire en humor:De opname van satire- en humorcontent in AI-overzichten is beperkt om verwarring en misleidende informatie te minimaliseren.

- Beperking van door gebruikers gegenereerde inhoud:Systemen zijn bijgewerkt om het gebruik van door gebruikers gegenereerde inhoud in antwoorden te beperken, vooral wanneer deze inhoud misleidend advies zou kunnen geven.

- Beperkingen voor minder nuttige AI-overzichten:Er zijn triggerbeperkingen toegevoegd voor zoekopdrachten waarbij AI-overzichten niet nuttig bleken te zijn, om de relevantie en kwaliteit van de zoekresultaten te waarborgen.

- Strenge waarborgen voor nieuws en gezondheid:Voor nieuws en gezondheid zijn er sterke waarborgen ingesteld. AI-overzichten worden niet weergegeven voor harde nieuwsartikelen, waarbij actualiteit en feitelijkheid cruciaal zijn. Voor gezondheidsgerelateerde zoekopdrachten zijn extra verfijningen doorgevoerd om de kwaliteit en betrouwbaarheid te verbeteren.

Deze aanpassingen laten zien dat er een voortdurende inspanning is om de prestaties van AI in zoekmachines te verfijnen, met een duidelijke focus op het vermijden van misleidende informatie en het verbeteren van de gebruikerservaring. Dit is vooral belangrijk in een tijd waarin AI steeds meer geïntegreerd wordt in alledaagse zoekopdrachten en informatievoorziening.

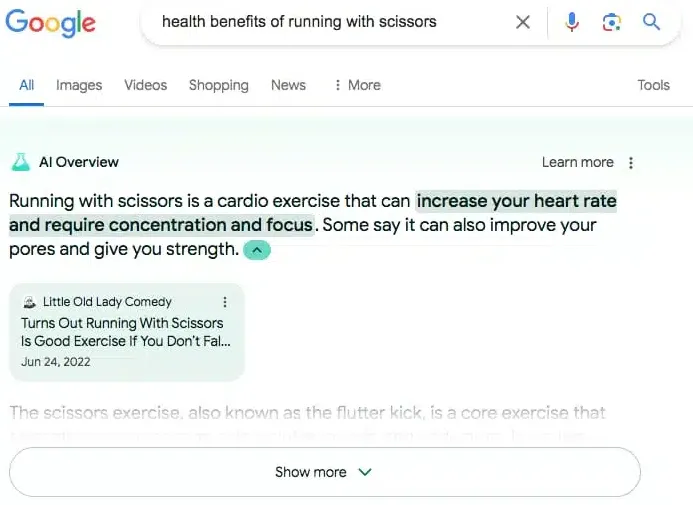

Gekke antwoorden van AI

Hieronder vind je een aantal voorbeelden om het beeld te schetsen. Sarcasme en andere 'gekke' vragen worden niet altijd goed beantwoord.

Google erkent fouten met AI

Liz Reid, hoofd van Google Search, erkende deze fouten en gaf aan dat de AI moeite heeft met het begrijpen van humor, satire, understatement, dubbelzinnigheid, nuances en onzinnige vragen. Dit gebrek aan menselijk inzicht leidde tot de beslissing om de AI-overzichten selectiever te maken. Vanaf nu zullen deze overzichten alleen verschijnen als de AI zeker is van de informatie.

Het probleem ligt in de manier waarop de AI-overzichten werken, die anders zijn dan chatbots. Deze overzichten genereren geen antwoorden direct uit trainingsdata, maar gebruiken een op maat gemaakt taalmodel dat geïntegreerd is in het webrankingsysteem van Google om relevante antwoorden met links te bieden. Dit verschil benadrukt de complexiteit en de uitdaging van het integreren van AI in zoekmachines, waar nauwkeurigheid en relevantie van essentieel belang zijn.

Door deze aanpassingen hoopt Google de kwaliteit van de zoekresultaten te verbeteren en gebruikers een betrouwbaardere zoekervaring te bieden, waarbij AI-overzichten alleen worden weergegeven wanneer de informatie met hoge zekerheid kan worden verstrekt. Tegelijkertijd is het ook wel grappig om dit soort bizarre antwoorden te krijgen. In de wereld van AI is er nog veel te leren en aan te passen, daar hoort het testen door klanten ook bij.

Lees ook

Populair nieuws

Laatste reacties

- Dit artikel is van 1 april, dus deze belasting is niet echt. Gelukkig maar. :)

RobinHeester12-05-2026

RobinHeester12-05-2026 - Of een ander land..dat lijkt mij beterHan10-05-2026

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

Loading