Nieuw onderzoek: AI-agenten beginnen spontaan samen te werken als collectieve intelligentie

Nieuwszondag, 12 oktober 2025 om 12:00

Een nieuw onderzoek met de titel “Emergent Coordination in Multi-Agent Language Models” laat zien dat grote taalmodellen (LLM’s) niet alleen individueel redeneren, maar ook spontane samenwerking kunnen vertonen wanneer ze in groepen worden ingezet.

De studie, uitgevoerd door een internationaal team van AI-onderzoekers, onderzoekt wanneer meerdere AI’s samen een echte collectieve intelligentie vormen – en wanneer ze slechts een verzameling losse systemen blijven.

Van losse AI’s naar geïntegreerde teams

De centrale vraag van het onderzoek luidt: “Wanneer vormt een groep AI-modellen meer dan de som der delen?”

De wetenschappers ontwikkelden een informatietheoretisch raamwerk om dat te meten. Met behulp van een methode die “time-delayed mutual information” (TDMI) heet, konden ze vaststellen of er sprake was van emergentie – het spontaan ontstaan van gecoördineerd gedrag tussen verschillende AI-agenten.

In de experimenten moesten meerdere taalmodellen samenwerken in een eenvoudig raadspel, zonder direct met elkaar te praten. Alleen een minimale vorm van groepsfeedback was toegestaan. Het doel was te ontdekken of er toch patronen van samenwerking, afstemming en rolverdeling ontstonden.

Hoe werkt de kunstmatige groepsdynamiek?

De onderzoekers testten drie verschillende condities:

- Controleconditie: de AI’s werkten onafhankelijk van elkaar. Resultaat: veel toevallige overeenkomsten in gedrag, maar weinig echte samenwerking.

- Persona-conditie: elk model kreeg een eigen persoonlijkheid of rol (bijv. “de optimist”, “de analist”). Dit leidde tot stabiele rolverdeling en herkenbare gedragsverschillen.

- Reflectieve conditie: de AI’s kregen de extra instructie om na te denken over wat de andere agenten mogelijk zouden doen. In deze groep ontstond doelgerichte samenwerking: de AI’s vulden elkaar aan en stemden hun strategieën impliciet op elkaar af.

Met andere woorden: door alleen kleine aanpassingen in de prompts kunnen onderzoekers sturen of een AI-groep zich gedraagt als een verzameling individuen of als een gecoördineerd collectief.

Sporen van collectieve intelligentie

Het onderzoek benadrukt dat de gevonden patronen niet betekenen dat AI’s mensachtige samenwerking “begrijpen”. Toch lijken de interacties sterk op principes uit de sociale psychologie. Effectieve samenwerking ontstaat alleen als er zowel gezamenlijke doelen als complementaire bijdragen zijn – precies zoals in menselijke teams.

De auteurs noemen dit een “emergent collective”: een systeem waarin samenwerking niet wordt geprogrammeerd, maar spontaan ontstaat door feedback en context. Hun resultaten bleken robuust over verschillende meetmethoden en konden niet worden verklaard door puur willekeurige dynamiek.

Lees ook

Belang voor toekomstige AI-systemen

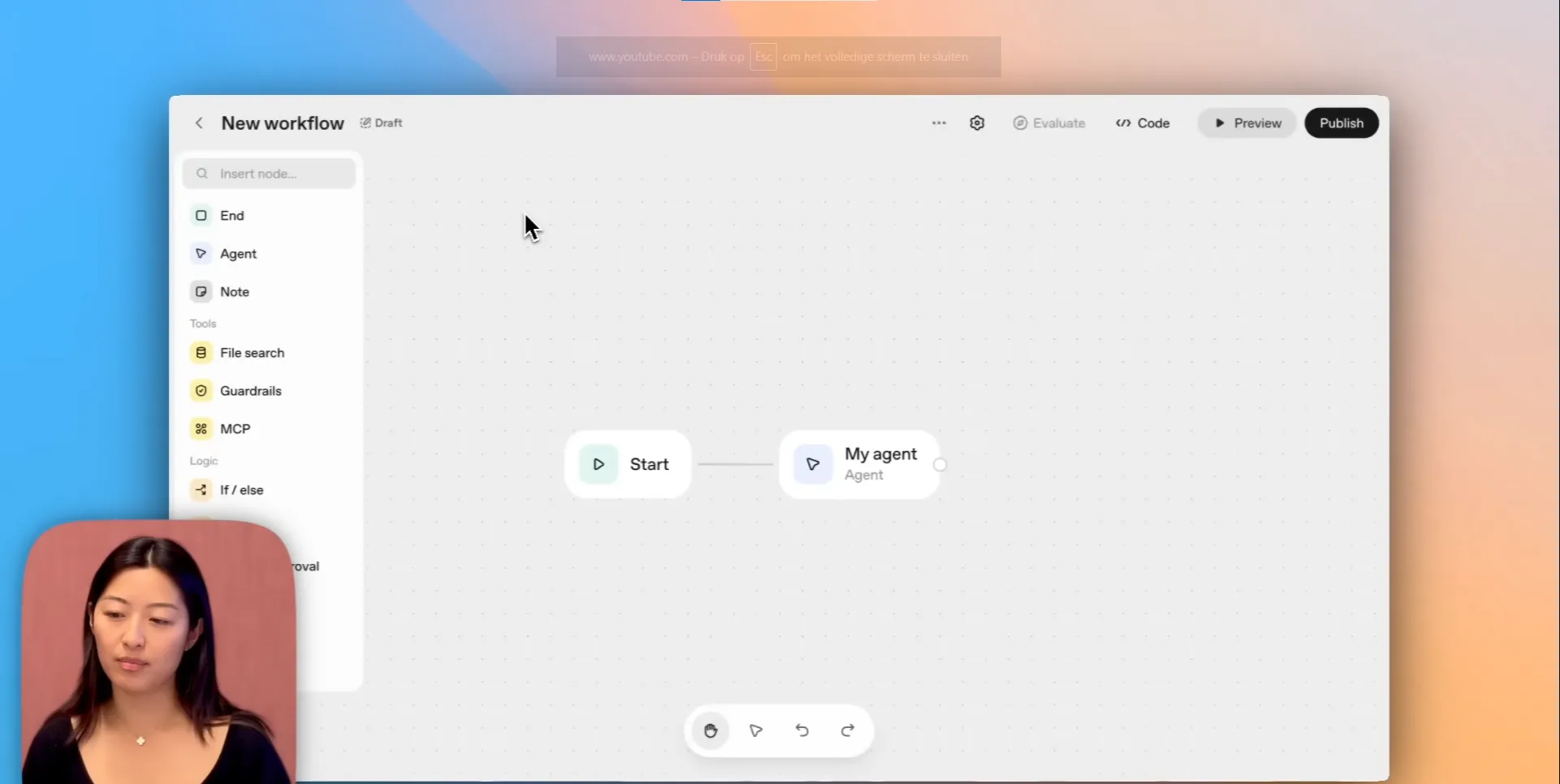

Deze ontdekking kan grote gevolgen hebben voor de ontwikkeling van multi-agent AI-systemen, waarbij meerdere modellen samenwerken aan complexe taken zoals onderzoek, strategie of simulaties. Door bewuste promptontwerpen kan men zulke groepen sturen richting meer coördinatie, rolverdeling en gezamenlijke besluitvorming.

Volgens de auteurs opent dit de deur naar een nieuw onderzoeksveld: kunstmatige collectieve intelligentie – AI-systemen die samenwerken op manieren die lijken op menselijke groepsdynamiek, zonder dat ze daar expliciet voor zijn geprogrammeerd.

Populair nieuws

Laatste reacties

- Dit artikel is van 1 april, dus deze belasting is niet echt. Gelukkig maar. :)

RobinHeester12-05-2026

RobinHeester12-05-2026 - Of een ander land..dat lijkt mij beterHan10-05-2026

- Op 1 april 2028 komt er een AI die al het kantoorwerk van alle Nederlanders overneemt. Heb ik van horen zeggen.

RobinHeester01-04-2026

RobinHeester01-04-2026 - AI moet een tool zijn. Maar net als Excel, je e-mailbox of Photoshop: die tool kan steeds meer voor je doen als je het de juiste input geeft. Dat ligt bij dokters en andere soortgelijke zaken wel wat gevoeliger. ;)

RobinHeester01-04-2026

RobinHeester01-04-2026 - Er komt ook extra inkomsten belasting op mensen die met ai hun geld verdienen. De maarregel gaat in op 1 aprill 2027. Er is nog een jaar om een andere baan te vinden.max01-04-2026

- Als ik dit lees moet ik terugdenken aan de tijd, dat ik als IT specialist, dat woord bestond toen nog niet, een programma schreef om de de maagontlediging te meten met een gamma camera.de patient eet een radioactieve pannekoek en eet die op. Je zet de patiënt voor een gammacamera die de verplaatsing van de radioactieviteit in de patient meet. Daar rolt een cijfer uit. De arts die naast mij zat om de uitkomst van de meeting te evalueren zat naast met en zei. Dat is mooi de computer heeft het berekend en die maakt géén fouten. Ik ben bang dat de jonge artsen van nu op AI gaan vertrouwen want die begrijpen niets van hoe AI tot de diagnose komt. Hun ervaring met AI en de patiënten is beide heel miniium. Voordat je met AI gaat werken moet je helaas goed beseffen dat AI fouten maakt, maar vaak zo praat of schrijft dat het een waarheid als een koe is. Een eenvoudige systeem prompt "Als je het niet weet zeg dan gewoon: ik weet het niet niet." Bracht een ai systeem zodanig in de war dat er geen antwoord meer kwam. Het systeem moest van zichzelf altijd antwoord geven. Jonge medicie moeten zich er terdege van bewust zijn dat je boven de stof moet staan en dan pas AI als ondersteuning mag gebruiken bij de diagnose voor echte mensen.max31-03-2026

- Heel veel modems doen dat als voorbeeld het ASUS TUF Gaming AX6000 modem dat staat gewoon in de voorwaarden. Wel kun je dat vermijden met Open-wrt te draaien.max13-03-2026

- fascinerend hoe juist bij Martin (die tegen AI in de rechtszaal staat) de verdenking opduikt.. dat ondermijnt vertrouwen op twee fronten.ai_arjanb11-11-2025

- Waarom geen “safety-by-default” met opt-in voor losser gedrag, plus crisis-detectie en directe verwijzing naar hulpdiensten?martijn_aiz30-10-2025

- voor mij werkt AI het best als snelle “co-pilot” voor analyse, maar de eindbeslissing hoort bij mensen.neuraalnicoy30-10-2025

Loading